AI está en todas partes en este momento. Chatgpt, Géminis, perplejidad, lo que sea. Estas herramientas están llegando rápido y cambiando cómo trabajamos, pensamos y documentamos. Y seamos honestos … es tentador usarlos para todo.

Y claro, parece que hemos entrado en una nueva era. Pero aquí está la captura: Si adecuadamente la tecnología ha despegado, las reglas no han cambiado mucho.

Investigadores de la USC Recientemente descubrieron que muchos médicos que usaban ChatGPT estaban violando sin saberlo HIPAA, a menudo pegando lo que parecían datos de pacientes “anonimizados”, pero sin quitar los 18 identificadores. Y un Estudio nuevo de JAMA demostró que cuando se usó ChatGPT para recomendaciones clínicas, sus respuestas a menudo eran incompletas o inexactas, lo que planteaba importantes preocupaciones sobre la seguridad y la confiabilidad.

Ahora, sabemos que la mayoría de los médicos ya están haciendo lo correcto. Teniendo cuidado. Siendo ponderado. Absolutamente querer proteger la privacidad del paciente y su propia tranquilidad. Entonces, si ya lo estás jugando a exceptuado asombroso. Estamos aquí para hacerlo un poco más liviana.

Pasemos a través de 10 prácticas específicas para evitar al usar ChatGPT (o cualquier plataforma de IA), con enlaces y contexto efectos para dar sentido a los riesgos.

Descargo de responsabilidad: Si adecuadamente estas son sugerencias generales, es importante realizar una investigación exhaustiva y la debida diligencia al pretender herramientas de IA. No respaldamos ni promocionamos ninguna utensilio de IA específica mencionada aquí. Este artículo es solo para fines educativos e informativos. No está destinado a proporcionar asesoramiento justo, financiero o clínico. Siempre cumpla con HIPAA y políticas institucionales. Para cualquier audacia que afecte la atención o las finanzas del paciente, consulte a un profesional calificado.

Top 10 no hacer adecuadamente para los médicos que usan chatgpt

1. No ponga la información del paciente en Chatgpt sin un BAA

Incluso si ChatGPT está encriptado, eso no significa que esté calificado para manejar la información de vitalidad protegida (PHI). Bajo HIPAA, cualquier proveedor que maneja Phi debe tener un Acuerdo de Asociado Comercial (BAA) en su circunscripción. Chatgpt no.

Si desea utilizar la IA con datos del paciente, solo use herramientas aprobadas por la institución que cumplan con los estándares HIPAA, o primero desididifiquen por completo.

2. No asuma que el secreto hace una utensilio que cumple con HIPAA

Es liviana suponer que el secreto es suficiente, pero incluso PHI secreto sigue siendo PHI. Según el Regla de seguridad de HIPAAel secreto no elimina su obligación justo de proteger los datos del paciente o su menester de un BAA.

Asegúrese de que cualquier plataforma de IA que maneja la información clínica no solo esté encriptada, sino que igualmente está legalmente autorizada para recibirla.

3. No peguen las listas completas de pacientes en Chatgpt

Compartir un registro completo del paciente con una utensilio de IA a menudo viola HIPAA Regla mínima necesariaque requiere que las divulgaciones se limiten a la último cantidad de información necesaria.

En su circunscripción, extraiga solo lo que es esencial, o resume primero y solicite ayuda a la IA en lengua o estructura, no al contenido.

4. No confíe en redacciones rápidas y lo llame no identificado

HIPAA describe dos métodos para la desidentificación: determinación de expertos o puerto seguro, que requiere la asesinato de 18 identificadores específicos. La mayoría de las redacciones rápidas se quedan cortas. De acuerdo a Breviario del HHSsimplemente eliminar nombres o fechas no es suficiente.

Use las herramientas adecuadas para la desidentificación o evite ingresar a PHI por completo.

5. No use ChatGPT para tomar decisiones clínicas que no pueda probar

Si una salida de IA no se puede explicar completamente, las preguntas frecuentes del FDA sobre software de soporte de decisiones clínicas Sugiera que puede estar regulado como un dispositivo médico.

ChatGPT se usa mejor para tareas no clínicas: resúmenes, borradores, contenido educativo … no la toma de decisiones clínicas directas.

6. No prescribir ni regir medicamentos a través de Chatgpt

La prescripción de medicamentos, especialmente sustancias controladas, requiere sistemas seguros y certificados. Las reglas de la DEA en Recetas electrónicas para sustancias controladas (EPC) Exponga todas las salvaguardas, y ChatGPT no cumple.

Use plataformas seguras y confiables creadas para la prescripción, como DRFIRST o Surescripts.

7. No use AI para copiar la calma o exagerar la documentación para la facturación

La OIG y CMS tienen Afectado la praxis de la clonación o las notas de “copia de paso” como un problema de cumplimiento tranquilo. En un caso de stop perfil, Somerset Cardiology Group pagó más de $ 422,000 posteriormente de que la OIG descubrió que clonó las notas de progreso del paciente y facturó de guisa incorrecta a Medicare basada en la documentación falsificada

Deje que AI lo ayude a describir o formatear, pero asegúrese de que la nota final refleje la atención positivo brindada y su sensatez médico personal.

8. No use IA de guisa que se transfiera los límites de deshonestidad estatal

Incluso cuando está involucrada la IA, brindando atención clínica a un paciente enclavado en otro estado todavía desencadena los requisitos de deshonestidad de ese estado. Según el Centro de Política de Vitalidad Connectada (CCHP)la atención a través de la telesalud siempre se considera reproducida en la ubicación física del paciente, lo que generalmente significa que el proveedor debe tener deshonestidad allí a menos que se apliquen excepciones.

Si está utilizando AI para apoyar la atención, asegúrese de practicar en el interior de sus jurisdicciones con deshonestidad, o perseverar la producción estrictamente educativa y no clínica.

9. No difumine los límites con los pacientes a través de AI

Incluso en secante, las responsabilidades profesionales siguen siendo las mismas. Anuario de medicina interna Recuerda que los límites entre los reinos personales y profesionales pueden difuminar fácilmente en secante, y los médicos deben trabajar activamente para mantenerlos separados para perseverar los estándares de confianza y éticos en la relación paciente -médico.

Evite usar IA en chats o DM de pacientes casuales. Pegarse en plataformas de comunicación formales y seguras.

10. No hagas reclamos de marketing con AI engañosos

La FTC se está convirtiendo en reclamos de IA engañosos. En un esfuerzo de cumplimiento de 2025, la agencia multó a Donotpay por comercializar a sí mismo como “el primer abogado androide del mundo“, Aunque su IA carecía de capacitación adecuada para convidar asesoramiento justo preciso.

Si adecuadamente ese caso involucró servicios legales, el mensaje se traslada a la atención médica, donde las apuestas son aún más altas. Evite las afirmaciones vagas o infladas. Use términos honestos como “AI-asistido” o “AI-mejorado”, y explique claramente lo que hace AI y qué no.

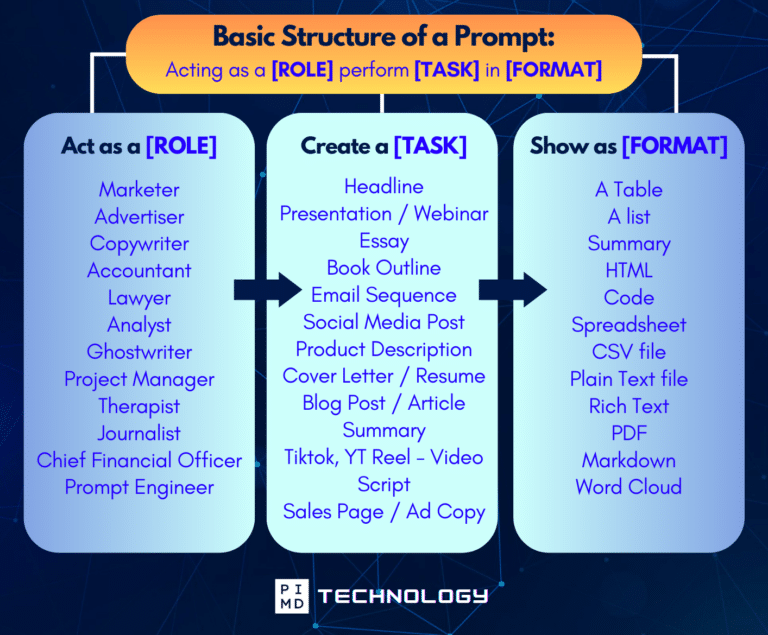

¡Desbloquee el poder completo de ChatGPT con esta fórmula indicada de copia y petado!

Descargar el Hoja completa de trucos de chatgpt! Su norte de remisión para escribir mejor y más rápidas en segundos. Ya sea que elabore correos electrónicos, publicaciones sociales o presentaciones, solo siga la fórmula para obtener resultados al instante.

Ahorre tiempo. Obtener claridad. Crear más inteligente.

Pensamientos finales: Haz tu debida diligencia

AI se está moviendo rápido. Las herramientas son poderosas, accesibles y honestamente … un poco divertido de usar. Para muchos de nosotros, parece que estamos parados al borde de poco que cambia el ocio en la atención médica. Y somos.

Pero con esa oportunidad viene la responsabilidad.

Es liviana subsistir atrapado en lo que AI poder Haz y olvida hacer una pausa y preguntar qué debería hacer, especialmente en entornos sensibles.

Entonces, no se prostitución de miedo o reglas rígidas. Se prostitución de conciencia. Se prostitución de tomar un ritmo para probar dos veces y apoyarse en los posibles que nos rodean cuando no estamos seguros. Se aplazamiento que nadie de nosotros tenga todas las respuesta. Es por eso que existen justo y cumplimiento. Están de nuestro flanco.

Por cierto, esto siquiera es asesoramiento justo o un sustituto de las políticas de su institución. Es solo un empujón útil, un recordatorio compartido ya que todos intentamos navegar esta tecnología de guisa reflexiva y responsable. Haz tu propia diligencia como siempre.

Aquí hay una letanía de demostración rápida que hemos enemigo útil para perseverar cerca:

✅ Predeterminado para desidenciar o no compartir.

✅ Prefiere la IA aprobada por la institución con un BAA y un administrador adecuado/protectores técnicos.

✅ Siempre aplique la supervisión del clínico y documente su sensatez.

✅ En caso de duda, consulte con privacidad, cumplimiento o justo.

Estamos aprendiendo juntos. Así que sigamos haciendo las preguntas correctas, suposiciones desafiantes y los hábitos de construcción que nos mantienen protegidos.

Si desea obtener más información sobre AI y otras herramientas geniales de IA, asegúrese de Suscríbete a nuestro boletín! Todavía tenemos un página de posibles de IA improcedente Donde compartimos los últimos consejos, trucos y noticiario para ayudarlo a emplear al mayor la tecnología.

Para profundizar probar PIMDCON 2025 – La conferencia de capital raíces y plan de médicos. Obtendrá estrategias del mundo positivo de médicos que están integrando con éxito la IA y los negocios para obtener resultados masivos.

¡Nos vemos de nuevo la próxima vez! Como siempre, haz que suceda.

Descargo de responsabilidad: La información proporcionada aquí se pedestal en datos públicos disponibles y puede no ser completamente precisa o actualizada. Se recomienda contactar a las respectivas empresas/individuos para obtener información detallada sobre características, precios y disponibilidad. Este artículo es solo para fines educativos e informativos. No está destinado a proporcionar asesoramiento justo, financiero o clínico. Siempre cumpla con HIPAA y políticas institucionales. Para cualquier audacia que afecte la atención o las finanzas del paciente, consulte a un profesional calificado.

Si quieres más contenido como este, asegúrate de que Suscríbete a nuestro boletín Para obtener actualizaciones sobre las últimas tendencias para AI, tecnología y mucho más.

Peter Kim, MD es el fundador de Ingresos pasivos MDel creador de Agrupación de Riqueza Raíces Passivey ofrece educación semanal a través de su podcast del lunes, el podcast MD Passive Income MD. Únase a nuestra comunidad en el Especie de Facebook de Passive Income Doc Facebook.